ChatGPTを活用しよう(前編)

執筆者:テクニカルライター 掌田津耶乃

現在、ITの世界を席巻している「ChatGPT」。AIを使えば業務も効率アップできるのでは、と考えている人も多いことでしょう。ここでは「どのようにChatGPTを導入すべきか」について考えてみましょう。

生成系AIの実力は?

「ChatGPT」は、この10年ほどの間で登場した技術の中でもっとも破壊的なパワーを持つものでしょう。AIは、それまでの「カタコトしか話せない機械」から「話せば大抵のことは教えてくれる物知りな友人」レベルに進化しました。ChatGPTを取り入れた新しいサービスやプログラムが矢継ぎ早に発表され、今や「ChatGPTにいかに乗り遅れないか」が企業にとって最も重要な戦略となりつつあります。

アプリやサービスを開発しているところなら、「とにかく早くChatGPTに対応する」ことは至上命令でしょう。では一般の企業団体ではどうでしょうか。多くの企業では、どこまでChatGPTの利用を許可すればいいのか、そもそもどう利用するのがいいのか、対応に苦慮しているところも多いことでしょう。

筆者は、「ChatGPTの活用」はもはや避けられないものだと考えます。これほどに強力な新技術が登場したのですから、それを活用しないのはあまりにもったいないことです。「そんなことはわかってる。だが......」と反論しかかっている人。今、あなたに必要なのは「ChatGPTの是非を判断すること」ではありません。

必要なのは「そもそもChatGPTとはどういうものか」を理解することです。どういうものかわからなければ、判断のしようがないのですから。ChatGPTがどういうものかを正しく理解できれば、「どう活用すべきか」も自ずと見えてくるはずです。

ChatGPTは「質問に答えるAI」ではない

ChatGPTの活用について頭を悩ませている人の多くが指摘するのが、生成するテキストの「信頼性」でしょう。ChatGPTに限らず、生成系AIが生成するテキストでは、事実とは異なる不正確な回答を生成してしまうことがあります。これは「ハルシネーション」と呼ばれ、AIが全く現実とは違うことを妄想しているように見えるでしょう。「こんなとんでもない回答をするAIを信頼なんてできない」と思う人も多いのではないでしょうか。

こうした人の多くは、AIの働きを勘違いしています。AIは「質問するとその回答を考えて返すもの」と思っている人。それは違います。少なくとも、現在のChatGPTのように大規模言語モデルを使ってコンテンツを生成するAIは、「質問の回答を考えて作成」などしていません。

この種のAIが行っていること。それは「テキストの続きを生成すること」です。例えば、このような会話を考えて下さい。

回答:私の名前は、山田です。

人間であれば、「あなたの名前はなんですか?」という質問を理解し、その質問の答えを考えて「私の名前は山田です。」と返していることでしょう。しかし、生成系AIはそのように処理しません。

生成系AIは、蓄積された学習データから、「"あなたの〇〇は何ですか?" というテキストの後には、"私の〇〇は✕✕です。" というテキストがくるのが一般的だ」ということを推測してテキストを生成しているだけなのです。生成されるテキストの「意味」は、全く考えません。実際、この質問をすると、実行する度に答えの名前は違ってきます。「自分の名前」という意味などAIは考えないのです。ただ「ここに、名前に相当する値を当てはめられたコンテンツを作ればいい」ということだけ理解して処理をしているのですね。

プロンプトデザインを理解する

AIに送信する質問文のことを「プロンプト」と呼びます。ChatGPTをうまく活用するためには、このプロンプトをいかに作り出すか、これが最大のポイントとなります。「ただ、知りたいことを質問すればいいのでは?」と思ったかも知れませんが、実はそんな単純なものではないのです。

「あなたの名前は?」というような非常に単純なものならば深く考える必要はないでしょう。けれど、もっと複雑なことを行わせたい場合、「どのようにプロンプトを作成するか」が重要となります。

こちらが望むコンテンツが得られるようにプロンプトを設計することを「プロンプトデザイン」と呼びます。イメージを生成するAIでは、このプロンプトデザインの重要性(どんなプロンプトを書けば思い通りのイメージが作られるか)がよく話題となりますが、テキストの生成でもプロンプトデザインは重要なのです。

指示(Instruction)を活用する

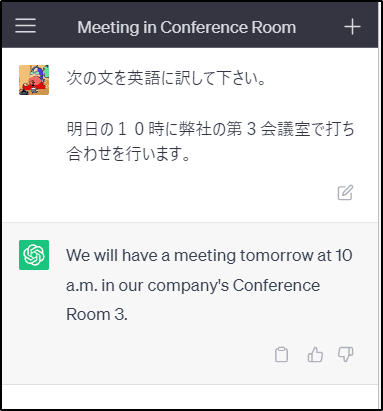

プロンプトデザインのもっとも基本となるのは「指示(Instruction)」と「プライマリコンテンツ(Primary Content)」です。「指示」とは、AIに実行させる内容を記述したものであり、プライマリコンテンツはその対象となるコンテンツを示します。例えば、こんなプロンプトを考えてみましょう。

明日の10時に弊社の第3会議室で打ち合わせを行います。

これを実行すると、2行目のテキストが英訳されて出力されます。1行目に書かれたものが「指示」であり、2行目がプライマリコンテンツです。1行目の指示に従い、2行目のテキストを英訳していたのですね。

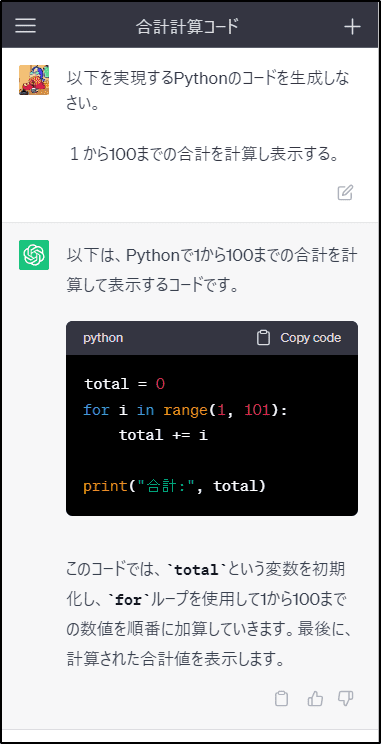

この「指示」を正しく指定することで、AIの応答をかなり正確に制御できるようになります。例えば、以下のようなプロンプトを実行させたとしましょう。

1から100までの合計を計算し表示する。

これで、1~100の数字を合計するPythonのコードが生成されました。こうした「プログラムのコード生成に関しては、ChatGPTはかなり強力です。最新のフレームワークなどへの対応はできないことが多いですが、基本的な言語のコード生成はかなり正確に行えます。

これは、先に述べた「文の続きを生成する」というAIの仕組みを考えればよくわかるでしょう。世界中の開発系サイトでは無数の質問がされており、多くはその回答として正しいコードが提示されています。「〇〇のコードを教えて下さい」「それは✕✕のように書きます」といったやり取りをAIモデルは無数に学習しているのです。これにより、AIはプログラミング系の質問には「ほぼ正しい回答」を生成できるようになっているのです。

この指示は、応用次第で様々な用途に用いることができます。例えば、自社製品名を指定して「当社の製品〇〇の使い方について以下の質問に答えなさい。」と指示を用意してプライマリコンテンツを入力させれば、簡単なQ&Aのチャットができてしまいます。

プロンプトデザインについては、さまざまなテクニックが考え出されています。まずは、基本である「指示」の使い方をしっかりと理解して下さい。そして的確な応答が得られるようプロンプトを作る作業に慣れておきましょう。

AIが得意なこと・不得意なこと

この「指示」を使ったプロンプトは、AIに対し「特定の役割を与える」というものです。こうした特定の役割に限定して質問をする場合、AIからの応答はかなり正確なものになります。もちろん、完全ではありませんが、例えば先ほどのPythonのコードを生成される例などは実際にコードを実行すれば正しく生成できているかどうかわかります。「役割を限定し、結果を自分で検証できる」のであれば、AIは非常に便利な相棒となってくれるのです。

では、不得意なことは何でしょうか。それは「正確さが要求される作業」です。プログラムのコードは、もちろん正確さが要求されますが、多少不正確であっても(実際に動かせばすぐに間違いが分かるので)十分に役に立ちます。しかし、場合によっては「不正確だと大きな問題が発生する」というケースもあります。

米国では、弁護士が資料作成にAIを利用したところ、存在しない判例を引用したコンテンツを作成してしまい大きな問題となりました。米国連邦地方裁判所はこの弁護士に対し、非実在の判例を引用したとして5000ドルの罰金を課しています。業務に関係することで、事実誤認によって損害が発生するような場合、AIをそのまま使うのはかなり問題でしょう。

例えばマーケッティングのレポートにAIの応答を利用した場合、架空の統計データを元に説明を行うかも知れません。カスタマーサービスで利用した場合、製品にない機能を説明してしまう可能性もあります。

先に説明したように、AIは結果が正しいかどうかを検証しません。業務に関する応答は、常に「応答の真偽を確認した上で利用する」ということを徹底する必要があります。

AIに行ってはいけないこと

では、応答の真偽確認さえすれば、AIはどのように利用しても問題ないでしょうか。いいえ、そうではありません。特に業務に関することでAIを利用する場合、注意すべき点があります。

何よりも重要なのは、「機密情報を決して入力してはいけない」という点です。AIは、多量のデータを学習して動いています。プロンプトから生成される応答は、こうした学習データを元に生成されます。いわば、「どこかで誰かが書いたテキストをツギハギして応答を作っている」といってもいいでしょう。機密情報をAIにプロンプトとして送ってしまった場合、その情報が他の何処かで使われ応答として表示されないとも限りません。

ChatGPTの開発元であるOpenAIは、ユーザーの個人情報や機密情報がそのままAIからの返答として表示されることはない、といっています。しかし特定の状況や要求によっては、プロンプトの一部が応答に含まれる可能性があることも認めています。次回説明する予定ですが、現在「プロンプトインジェクション」と呼ばれるAIモデルへの攻撃も多数確認されています。こうした攻撃により、AIに入力した社外秘の情報が流出されてしまう可能性がないとは言い切れないでしょう。

同じ理由で、社員や取引先などの個人情報についても決して入力しないように注意して下さい。基本的に「AIに入力した情報は外部に漏れる可能性がある」と考えて利用する、と考えましょう。

この記事の執筆者

テクニカルライター

掌田津耶乃様

エンジニアを育成するIT研修

インターネット・アカデミーでは、多くの企業様からChatGPTやAI活用に関するIT研修のお問い合わせをいただいております。ChatGPTの活用はもちろん、AIリテラシーやデータ利活用に強いデジタル人材育成のカリキュラムや導入事例が多数あります。デジタル人材育成にお悩みの方はお気軽にご相談ください。

デジタル人材育成について相談するデジタル人材育成・助成金のお役立ち資料をダウンロード

デジタル人材育成や助成金活用のお役立ち資料などをまとめてダウンロードしていただけます。コンサルタントへの無料相談をご希望の方はこちらからお問い合わせください。

- DX人材の育成&事例紹介 リスキリングのロードマップ付き

- デジタル人材育成に使える助成金制度

- デジタルスキル標準 役割別おすすめ講座